Faire son mémoire avec l’IA : quels sont les risques ?

Planifier un mémoire, reformuler un passage, clarifier une problématique ou gagner du temps sur la rédaction est désormais possible en quelques clics. Cette facilité apparente pousse de nombreux étudiants à se demander jusqu’où ils peuvent aller sans se mettre en danger.

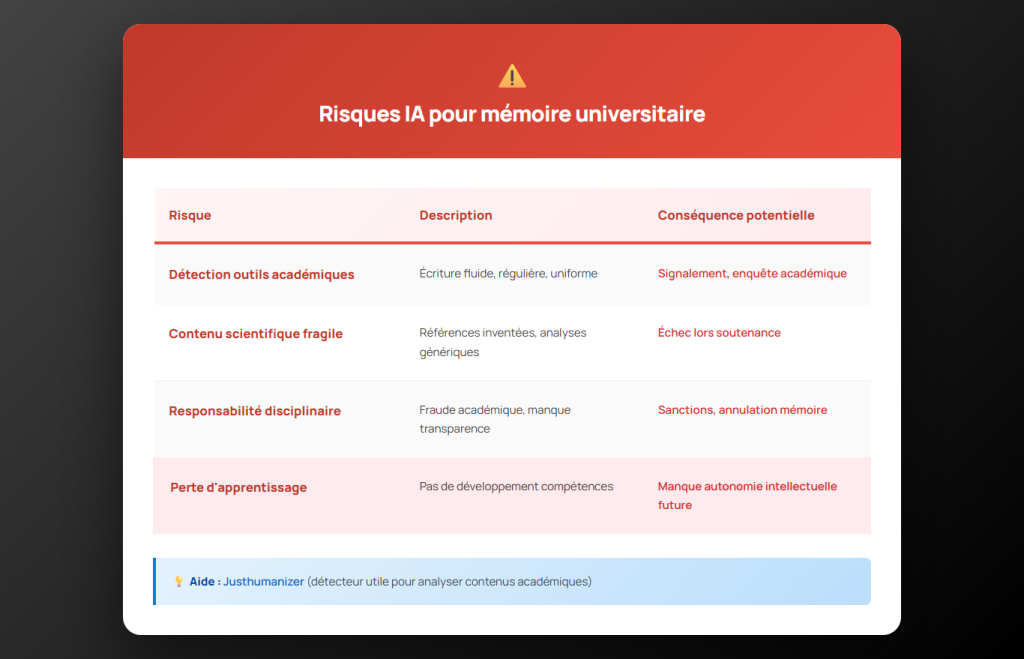

Faire son mémoire avec l’IA n’est pas illégal en soi, mais les risques sont bien réels. Ils ne se limitent pas à la simple détection par un logiciel, et touchent des dimensions plus profondes : validité scientifique, évaluation académique, responsabilité intellectuelle et crédibilité du travail produit.

Résumé

- 1 Pourquoi l’IA est si tentante pour rédiger un mémoire

- 2 Risque n°1 : la détection par les outils académiques

- 3 Risque n°2 : un contenu scientifiquement fragile

- 4 Risque n°3 : la responsabilité académique et disciplinaire

- 5 Le risque le plus sous-estimé, la perte d’apprentissage

- 6 Les principaux risques à utiliser l’IA pour un mémoire

- 7 Ce que l’IA peut faire sans risque et ce qu’elle ne doit pas faire

- 8 Comment réduire les risques si l’IA est utilisée

- 9 Le regard des jurys évolue, mais les exigences restent

Pourquoi l’IA est si tentante pour rédiger un mémoire

Un mémoire est un exercice long, exigeant, souvent stressant. L’IA promet de réduire cette charge en aidant à structurer les idées, reformuler des passages complexes ou produire rapidement du texte cohérent. Pour des étudiants peu à l’aise à l’écrit ou sous pression de temps, l’outil devient rapidement central.

Justhumanizer : détecteur IA fiable et robuste ⭐9,5/10

Prenez les devants ! Justhumanizer.com est le meilleur détecteur ia haute qualité du marché Francophone 🇫🇷 !On recommande 👍

Avantages

✔ Détection rapide et avancé pour plus de fiabilité✔ Analyse de mots IA

✔ Fiabilité 98%

✔ Essai gratuit

Avantages

❌ Limité au texte de 5000 mots par scan pour l'instantLe problème est que le mémoire n’est pas un simple document rédactionnel. Il est censé démontrer une capacité à raisonner, à problématiser, à analyser des données et à produire une réflexion personnelle. Or, l’IA excelle dans la forme, mais reste limitée sur le fond scientifique réel.

Risque n°1 : la détection par les outils académiques

Le risque le plus visible est celui de la détection. De plus en plus d’universités utilisent des outils capables d’estimer si un texte a été généré ou fortement assisté par une IA. Ces détecteurs ne cherchent pas une preuve absolue, mais évaluent la probabilité statistique d’une génération automatique.

Un mémoire rédigé majoritairement par IA présente souvent une écriture très fluide, très régulière, avec peu de variations stylistiques. Ces signaux augmentent le risque d’être signalé, surtout si l’étudiant n’a pas retravaillé le texte en profondeur.

Des plateformes comme Justhumanizer sont justement utilisées pour analyser ce type de contenu académique et aider à identifier les zones à risque. Mais même en l’absence de détection formelle, d’autres dangers subsistent.

Risque n°2 : un contenu scientifiquement fragile

Un angle souvent négligé est la qualité réelle du raisonnement produit par l’IA. Un mémoire généré ou fortement assisté peut sembler convaincant à la lecture, tout en étant méthodologiquement faible.

L’IA peut inventer des références, simplifier excessivement des débats théoriques, ou produire des analyses génériques qui manquent de profondeur. Ces faiblesses apparaissent rarement dans le texte lui-même, mais deviennent évidentes lors de la soutenance, lorsque l’étudiant doit défendre ses choix, expliquer sa méthode ou justifier ses résultats.

Le risque n’est donc pas seulement d’être détecté, mais de ne pas maîtriser son propre travail.

Risque n°3 : la responsabilité académique et disciplinaire

Dans la majorité des établissements, l’étudiant reste pleinement responsable de ce qu’il remet, quel que soit l’outil utilisé. Utiliser l’IA sans autorisation explicite ou sans la mentionner est assimilé à une forme de fraude académique, selon les règlements internes.

Les sanctions peuvent aller d’une simple pénalisation de la note à l’annulation du mémoire, voire à des mesures disciplinaires plus lourdes. Le flou actuel autour de l’IA ne protège pas l’étudiant, bien au contraire : il renforce l’exigence de transparence.

Le risque le plus sous-estimé, la perte d’apprentissage

Au-delà des sanctions ou de la détection, le risque le plus profond est souvent invisible. Rédiger un mémoire est un processus d’apprentissage intellectuel. C’est dans l’effort de formulation, d’analyse et de structuration que se construit la compréhension du sujet.

Lorsque l’IA prend trop de place, l’étudiant peut produire un document correct sans avoir réellement développé les compétences attendues. Cette perte se manifeste plus tard, en doctorat, en emploi ou lors de projets complexes, où l’autonomie intellectuelle devient indispensable.

L’IA peut accélérer, mais elle ne remplace pas le cheminement cognitif que le mémoire est censé évaluer.

Les principaux risques à utiliser l’IA pour un mémoire

Pour résumer, l’usage non maîtrisé de l’IA dans un mémoire expose à plusieurs risques majeurs :

- détection par des outils académiques de plus en plus performants,

- soupçon de fraude ou de non-respect du règlement universitaire,

- contenu théorique ou méthodologique superficiel,

- difficultés à défendre le travail lors de la soutenance,

- perte d’apprentissage et de compétences réelles,

- atteinte à la crédibilité académique de l’étudiant.

Ces risques augmentent proportionnellement au degré de dépendance à l’IA.

Ce que l’IA peut faire sans risque et ce qu’elle ne doit pas faire

L’IA est un outil d’assistance légitime lorsqu’elle est utilisée avec méthode. Elle peut aider à reformuler un passage, clarifier un plan, vérifier la cohérence globale ou améliorer la langue. Par contre, lui déléguer la construction de l’argumentation, l’analyse des données ou la rédaction intégrale du mémoire est particulièrement risqué.

La frontière n’est pas technique, mais intellectuelle. Tant que l’étudiant reste à l’origine des idées, des choix méthodologiques et des conclusions, l’outil reste un support. Dès que l’IA devient l’auteur réel du raisonnement, le risque académique explose.

Comment réduire les risques si l’IA est utilisée

La première règle est la transparence. De plus en plus d’universités acceptent un usage encadré de l’IA, à condition qu’il soit déclaré. La seconde est la réappropriation du texte : un mémoire doit être retravaillé, personnalisé, enrichi par des exemples précis et des références vérifiées.

Tester son mémoire avec un détecteur d’IA permet également d’identifier les passages trop artificiels et de les retravailler avant la remise. L’objectif n’est pas de tromper l’outil, mais de s’assurer que le texte reflète réellement un travail humain.

Le regard des jurys évolue, mais les exigences restent

Les jurys sont de plus en plus conscients de l’existence de l’IA. Ils ne cherchent pas systématiquement à piéger les étudiants, mais ils attendent une cohérence entre le document écrit, la soutenance et le niveau réel de compréhension.

Un mémoire trop “parfait”, sans aspérités, peut paradoxalement éveiller davantage de soupçons qu’un travail imparfait mais maîtrisé. L’authenticité intellectuelle devient un critère implicite d’évaluation.

Conclusion

Faire son mémoire avec l’IA n’est pas un risque en soi, mais en devient un dès que l’outil remplace la réflexion personnelle. Les dangers ne se limitent pas à la détection automatique : ils touchent la qualité scientifique, la crédibilité académique et l’apprentissage profond.

L’IA est un allié ponctuel, jamais un auteur invisible. Dans le parcours universitaire encore en adaptation, la meilleure stratégie reste la même : utiliser ces outils avec parcimonie, transparence et esprit critique. Un mémoire réussi n’est pas celui qui semble parfait, mais celui que l’on est capable de défendre, comprendre et assumer pleinement.