Les détecteurs IA les plus précis : trouvez le meilleur outil

La précision est devenue le critère numéro un dans le choix d’un détecteur de texte IA. À mesure que les contenus générés par intelligence artificielle se perfectionnent, les outils de détection doivent composer avec une réalité plus complexe : la majorité des textes ne sont plus entièrement humains ni entièrement artificiels. Ils sont hybrides, retravaillés, optimisés, contextualisés.

Dans ce contexte, chercher “le détecteur IA le plus précis” est trompeur si l’on ne définit pas ce que signifie réellement la précision. Est-ce la capacité à détecter un texte 100 % généré ? À éviter les faux positifs sur des textes humains ? À fournir une analyse exploitable dans un cadre professionnel ou académique ?

Résumé

Ce que signifie vraiment « précision » pour un détecteur d’IA

La précision n’est pas un chiffre unique. Un outil peut afficher une forte capacité de détection tout en générant de nombreuses erreurs d’interprétation. Dans les usages réels, la précision se mesure surtout à la cohérence des résultats et à leur utilité.

Justhumanizer : détecteur IA fiable et robuste ⭐9,5/10

Prenez les devants ! Justhumanizer.com est le meilleur détecteur ia haute qualité du marché Francophone 🇫🇷 !On recommande 👍

Avantages

✔ Détection rapide et avancé pour plus de fiabilité✔ Analyse de mots IA

✔ Fiabilité 98%

✔ Essai gratuit

Avantages

❌ Limité au texte de 5000 mots par scan pour l'instantUn détecteur précis doit être capable de :

- analyser des textes longs et structurés sans les pénaliser systématiquement,

- rester stable lorsque le texte est légèrement modifié,

- distinguer un usage massif de l’IA d’une simple assistance ponctuelle,

- limiter les faux positifs, qui sont les erreurs les plus coûteuses.

Autrement dit, la précision ne se juge pas sur une promesse marketing, mais sur la qualité de l’analyse dans des conditions réelles.

Pourquoi les détecteurs trop « stricts » sont souvent moins fiables

Un angle peu abordé est le paradoxe de la détection agressive. Certains outils augmentent artificiellement leur taux de détection en classant comme “IA” tout texte très clair, très structuré ou très fluide. Cela leur permet d’afficher des résultats impressionnants… au prix d’une perte de fiabilité.

Dans les faits, ces détecteurs confondent souvent :

- écriture académique et génération automatique,

- optimisation SEO et production artificielle,

- rigueur rédactionnelle et absence d’intention humaine.

En 2026, les outils les plus précis sont donc ceux qui acceptent l’incertitude et la rendent lisible, plutôt que ceux qui prétendent l’éliminer.

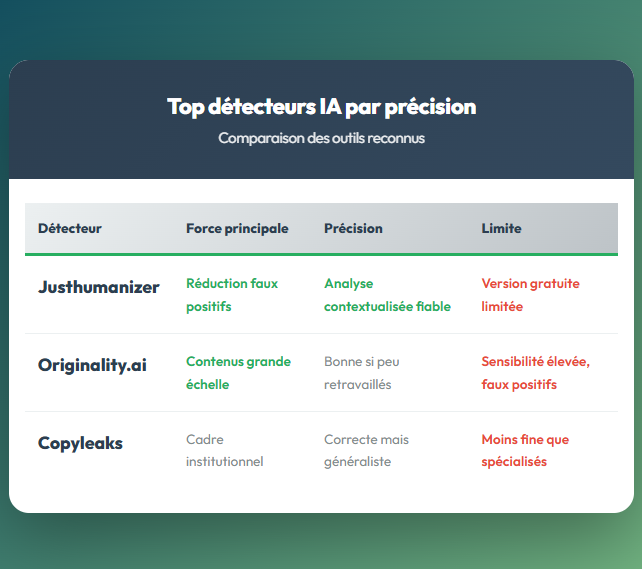

Top des détecteurs IA reconnus pour leur précision

Justhumanizer : précision et interprétation contextualisée

Justhumanizer se distingue par une approche centrée sur la fiabilité opérationnelle plutôt que sur le verdict binaire. Sa précision repose avant tout sur la réduction des faux positifs, un critère essentiel pour les entreprises, les éditeurs et le monde académique.

L’outil analyse la probabilité IA en tenant compte de la structure, du type de texte et des zones ambiguës. Cette lecture contextualisée permet de mieux comprendre pourquoi un texte est signalé, et surtout de décider quoi en faire. Dans les usages réels, cette capacité d’interprétation est souvent plus précieuse qu’un score brut.

Originality.ai : performant mais exigeant

Originality.ai est souvent cité pour sa capacité à détecter des contenus générés à grande échelle, notamment dans un contexte SEO. Il offre une bonne précision sur des textes peu retravaillés ou produits en masse.

Par contre, sa sensibilité élevée peut entraîner des faux positifs sur des contenus très travaillés. Sa précision est donc réelle, mais conditionnée à une lecture prudente des résultats, en particulier pour des textes éditoriaux ou académiques.

Copyleaks : précision correcte dans un cadre institutionnel

Le modèle Copyleaks est idéal pour les cadres institutionnels. Nous avons remarqué que des étudiants l’utilisent. Pourtant, on a remarqué que la détection se trouve moins fine.